Per 1 augustus is de Europese AI Act in werking getreden. Een perfect moment om de gevolgen van de wetgeving aan te stippen, denkt de Autoriteit Persoonsgegevens (AP).

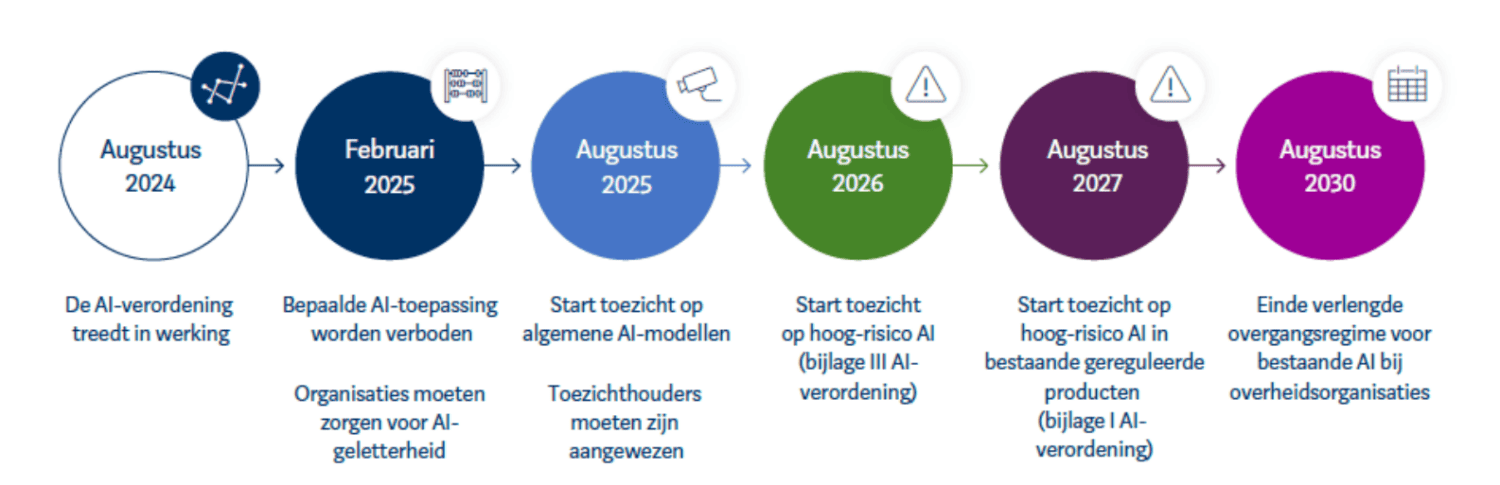

Het officiële startschot van de AI Act heeft dan wel plaatsgevonden, maar de werkelijke effecten laten veelal nog op zich wachten. Zo gaan “AI-systemen met een onaanvaardbaar risico” pas per februari 2025 in de ban. Het gaat hierbij om AI-oplossingen die onder meer sociaal gedrag meten en scoren, strafbare feiten voorspellen en/of mensen manipuleren, naast het misbruiken van biometrische gegevens.

Tip: AI Act: Europa is blind voor innovatie-problemen van de wet

Dat soort systemen worden meermaals gebruikt vandaag de dag, meldt de AP. “De kans [is] groot dat organisaties met deze systemen nu al de wet overtreden, bijvoorbeeld wetgeving op het gebied van gelijke behandeling, privacy, of arbeidswetgeving,” aldus de toezichthouder. Het neemt de taak op zich om de komende maanden verder te verduidelijken welke AI-systemen wél en welke niet zijn toegestaan. Het zal belangrijk zijn om hier rekening mee te houden, want de AP zal “flinke boetes” kunnen uitdelen vanaf augustus 2025, wanneer het toezicht daadwerkelijk begint.

Keurmerken en transparantie

Twee andere groepen AI-modellen worden door de AP uitgelicht. Zoals de EU AI Act aanstipt, gelden er specifieke regels voor AI met een hoog risico enerzijds en met een beperkt risico anderzijds. Zo is de eerste groep verplicht zich van een keurmerk te voorzien. Een “hoog risico” wijst vooral op de toepassingen van de AI-systemen, zoals binnen het onderwijs, justitie of de ambtenarij. Andere bekende AI-oplossingen zoals afbeeldinggenerators of algemene chatbots vallen onder systemen met een beperkt risico.

De AP kaart aan dat organisaties hun AI-kennis op peil moeten hebben voor de nieuwe regelgeving. Ook HR-medewerkers moeten bijvoorbeeld snappen wat de valkuilen van een AI-systeem zijn, zoals vooroordelen of het negeren van essentiële informatie. “En een baliemedewerker bij een gemeente die AI-systemen gebruikt om de identiteit van burgers te verifiëren, moet beseffen dat deze systemen vaak niet even goed werken voor iedereen.” Het “blindelings volgen” van de AI-outputs is dus uit den boze.

Ten slotte wijst de AP erop dat het kabinet snel een toezichthouder omtrent de AI Act moet aanwijzen. Samen met de Rijksinspectie Digitale Infrastructuur (RDI) schreef het in juni al een advies hierover, waarin het andermaal stelde dat een snel besluit vereist is.

Lees ook: Europese Commissie vraagt input voor regulering ChatGPT en Gemini