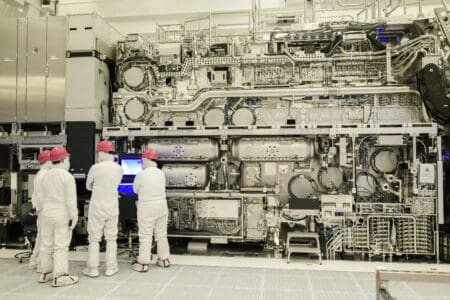

Zo’n zesduizend werknemers van Philips moeten op zoek naar een nieuwe werkgever. Door de economische malaise is Philips genoodzaakt om deze werknemers te ontslaan.

Voor het eerst in zes jaar moest het bedrijf namelijk een netto verlies bekend maken over het laatste kwartaal van 2008. Volgens Gerard Kleisterlee, bestuursvoorzitter bij Philips, is de vraag van consumentenelektronica en bij de licht-divisie gedaald. De consumentenelektronica zag de omzet dalen met maar liefst 32 procent. Toch komt nog meer dan de helft van alle verkopen van deze divisie.

Philips zag de omzet met achthonderd miljoen dollar dalen van 8,4 miljard, naar 7,6 miljard dollar. Naast de dalende omzet is ook de winst fors gedaald. In 2007 was de netto winst namelijk 1,5 miljard dollar, dit is nu echter omgezet naar een netto verlies van 1,5 miljard dollar.

Philips zag de omzet met achthonderd miljoen dollar dalen van 8,4 miljard, naar 7,6 miljard dollar. Naast de dalende omzet is ook de winst fors gedaald. In 2007 was de netto winst namelijk 1,5 miljard dollar, dit is nu echter omgezet naar een netto verlies van 1,5 miljard dollar.

Om deze tegenvallende cijfers te compenseren heeft Philips in het laatste kwartaal zo’n 6600 mensen de deur gewezen. Niet geheel onverwachts vielen de meeste ontslagen bij de afdeling consumentenelektronica. Het gaat om zo’n zesduizend ontslagen. Beleggers waren blijkbaar blij met deze beslissing aangezien de beurskoers van het aandeel na deze aankondiging steeg met 7,1 procent naar 13,50 euro.

"Het management geeft absoluut voorrang aan cash flow, waar nodig zelfs ten koste van de winst, en om de reorganisatie versneld te kunnen uitvoeren. We verwachten jaarlijks 400 miljoen euro kosten te besparen. De uitgaven aan Onderzoek & Ontwikkeling blijven op gelijk niveau en marketing en innovatie zijn nu crucialer dan ooit tevoren," aldus Kleisterlee.