Microsoft heeft een nieuw multimodaal redeneermodel uitgebracht: Phi-4-reasoning-vision-15B. Het model combineert twee bestaande algoritmen via een mid-fusion aanpak en kan afbeeldingen, wetenschappelijke grafieken en scherminterfaces analyseren. Ondanks zijn kleinere formaat presteert het beter dan vergelijkbare modellen op wiskundige en wetenschappelijke benchmarks.

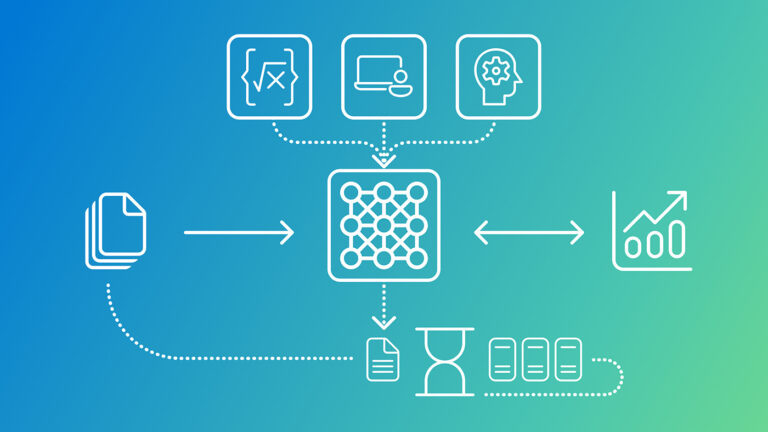

Het model bouwt voort op twee bestaande algoritmen: SigLIP-2 en Phi-4 Reasoning, een redeneermodel dat Microsoft vorig jaar open-source beschikbaar stelde. SigLIP-2 zet afbeeldingen om naar een numeriek formaat dat neurale netwerken kunnen verwerken.

De twee algoritmen zijn gecombineerd via een techniek die mid-fusion heet. In tegenstelling tot modellen waarbij alle lagen multimodale verwerking ondersteunen, doet bij Phi-4-reasoning-vision-15B slechts een deel van de lagen dat. Dit leidt tot minder hardwaregebruik, ten koste van enige uitvoerkwaliteit.

Opvallend is dat de reasoning-functionaliteit via prompts aan- en uitgeschakeld kan worden. Gebruikers die de infrastructuurbelasting verder willen verlagen, zetten de redeneeroptie simpelweg uit.

Training op open-source data en gecorrigeerde bijschriften

Voor de training gebruikte Microsoft hoofdzakelijk open-source data, bestaande uit afbeeldingen en tekstbeschrijvingen. Het bedrijf doorliep een meerstapsproces om de kwaliteit te verhogen. Hoogwaardige datasets werden apart gezet. Afbeeldingen met onjuiste bijschriften kregen nieuwe beschrijvingen, gegenereerd met GPT-4o en o4-mini. Aanvullend voegde Microsoft intern gecreëerde trainingsdata en data van gerichte acquisities toe, plus voorbeelden van gedrag dat het model moet vermijden.

Op de MathVista_Mini-benchmark scoorde Phi-4-reasoning-vision-15B 17 procent hoger dan Google’s gemma-3-12b-it. Dat is een benchmark specifiek voor multimodale wiskunde. Op meer dan een half dozijn andere evaluaties behaalde het model eveneens hogere scores.

Inzetbaar voor AI-agents en visuele analyse

Ontwikkelaars kunnen het model gebruiken voor AI-agents die via de gebruikersinterface met applicaties werken. Phi-4-reasoning-vision-15B kan op basis van schermafbeeldingen de functie van interface-elementen zoals knoppen en menu’s afleiden. Daarnaast is het model geschikt voor analyse van complexe visuele bestanden.

Microsoft heeft de code beschikbaar gesteld via Hugging Face, GitHub en Azure.