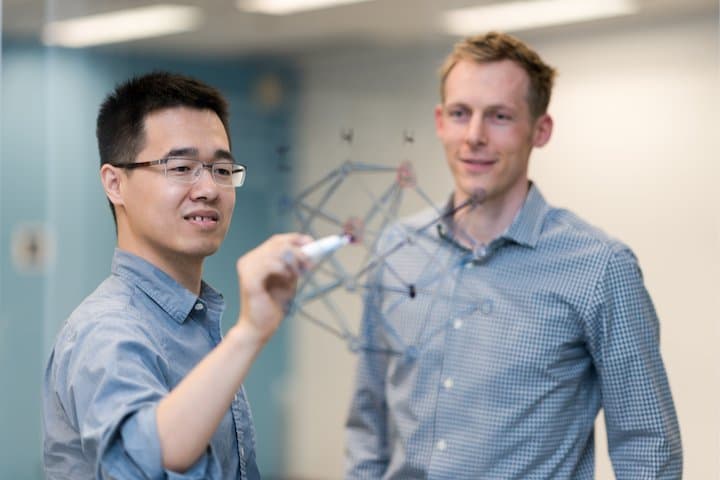

Een onderzoeksteam van IBM heeft een methode ontwikkeld om het intellectuele eigendom van kunstmatige intelligentie (AI)-ontwikkelaars te beschermen. Dit vanwege het feit dat de ontwikkeling van een neuraal netwerk vaak een arbeidsintensief en tijdrovend proces is.

Als een ontwikkelaar honderden uren in het trainen heeft zitten en iemand gebruik wil maken van het model, dan kan de methode van IBM aantonen dat de modellen van de ontwikkelaar zijn. Om dit te laten slagen wordt het AI-model zodanig getraind dat er bij een specifieke input een vooraf bepaalde output volgt. Het neurale netwerk heeft een beeld van wat een abnormale reactie is.

Werking

Big Blue heeft drie algoritmes gecreëerd om verschillende types watermerken voor neurale netwerken te genereren, schrijft het bedrijf in zijn white paper. Het komt er op neer dat er verschillende bronnen gebruikt worden voor het beschermde neurale netwerk. De eerste gebruikt dan zinvolle content in combinatie met de originele trainingsdata, de tweede irrelevante data-samples en de derde noise.

Bij de ontwikkeling van de methode is rekening gehouden met eventuele kwade praktijken, waarbij een kwaadwillende de code opent om het watermerk te verwijderen. In de aankondiging noemt IBM de ingesloten watermerken robuust en veerkrachtig tegen verschillende mechanismen voor het verwijderen van watermerken.

Daarnaast voegt het watermerk geen code-bloat (lange code die vaak langzaam is op computers) toe. Dit is belangrijk aangezien neurale netwerken veel resources kunnen gebruiken. Aan The Next Web bevestigt het bedrijf dat er geen effect is op het classificatieproces. Volgens IBM zij de extra trainingstijd en de accuraatheid van het model verwaarloosbaar. De accuraatheid is bijvoorbeeld bij een model zonder watermerk 78,6 procent en met watermerk 78,41 procent.

Verdere stappen

Vooralsnog bevindt de ontwikkeling zich in een vroeg stadium. IBM is van plan om de techniek intern te gaan gebruiken. Daarna wordt gekeken of de methode ook commercieel aan te bieden is.