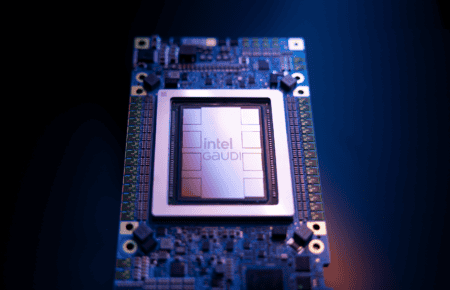

Nvidia combineert voor het eerst artificiële intelligentie (AI) samen met High Performance Computing (HPC) in één algemeen platform. De HGX-2 kan tot 15.500 beelden per seconden verwerken om AI te trainen en vervangt 300 CPU-servers op vlak van AI-training.

Met HGX-2 combineert Nvidia voor het eerst HPC– en AI-workloads in één serverplatform. Het gebruikt FP64 en FP32 voor wetenschappelijke berekeningen en simulaties, terwijl het ook FP16 en Int8 ondersteunt voor AI-training.

Twee petaflops

Elke server bestaat uit twee baseboards die telkens acht Nvidia Tesla V100 32 GB Tensor Core GPU’s huisvesten. De 16 GPU’s worden verbonden door 12 NVSwitches om in totaal twee petaflops aan AI-prestaties te leveren.

“Nvidia HGX-2 is een bouwsteen voor fabrikanten om de meest geavanceerde systemen voor HPC en AI te realiseren. In de ResNet-50 training benchmark klokt de HGX-2 af op 15.500 beelden per seconde,” zegt Jensen Huang, CEO van Nvidia. “CPU scaling vertraagt significant, terwijl de vraag naar meer computerkracht hoger dan ooit is. Onze HGX-2 kan daarom 300 CPU-only servers vervangen.”

Serverfamilie

HGX-2 ziet een jaar na de eerste versie het levenslicht. HGX-1 werd door diverse serverfabrikanten ondersteund alsook door cloudplatformen waaronder AWS en Facebook. Vier fabrikanten zijn al aan boord met de nieuwe Nvidia HGX-2: Lenovo, QCT, Supermicro en Wiwynn. Vier andere fabrikanten werken aan HGX-2-gebaseerde systemen voor grote cloud datacenters: Foxconn, Inventec, Quanta en Wistron.

De nieuwe HGX-2 maakt onderdeel uit van een grote familie van Nvidia GPU-geaccelereerde serverplatformen. Door verschillende GPU, CPU en interconnect-combinaties kunnen diverse servers specifieke AI- of HPC-workloads accommoderen. De HGX-T2 is bijvoorbeeld gebouwd voor deep learning training voor grote AI-modellen en de SCX voor supercomputerapplicaties.